deepseek-r1:国产大模型挑战openai,开源且性价比高!

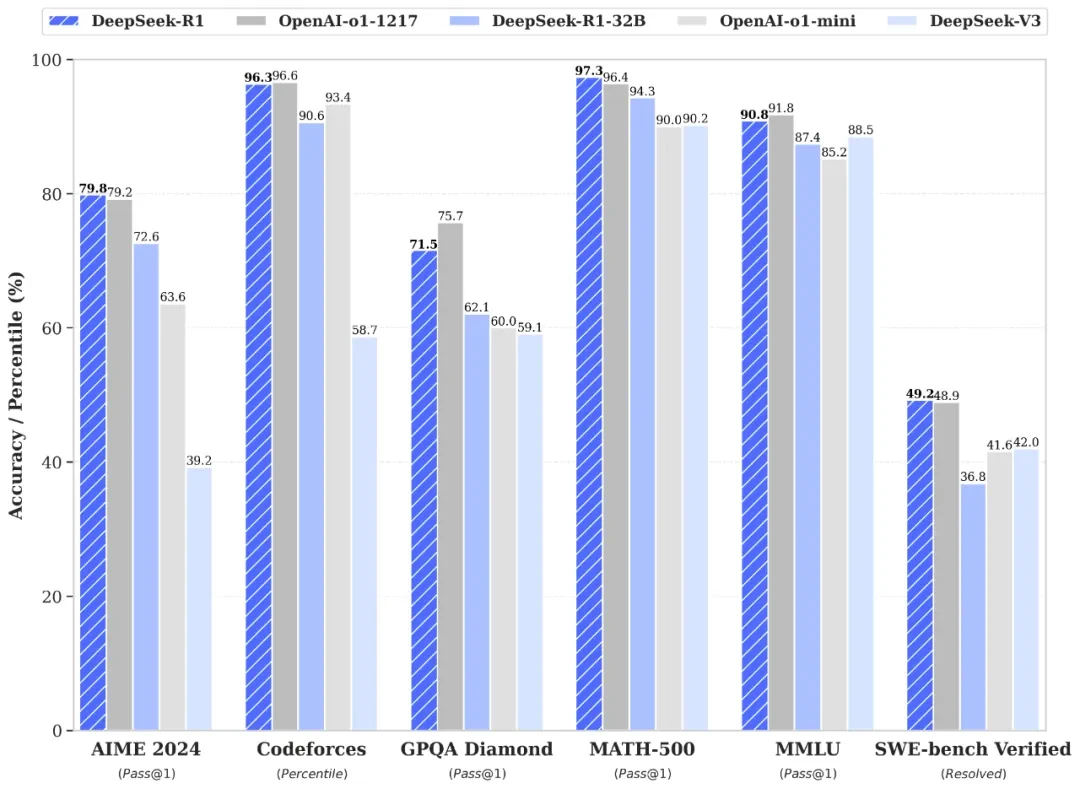

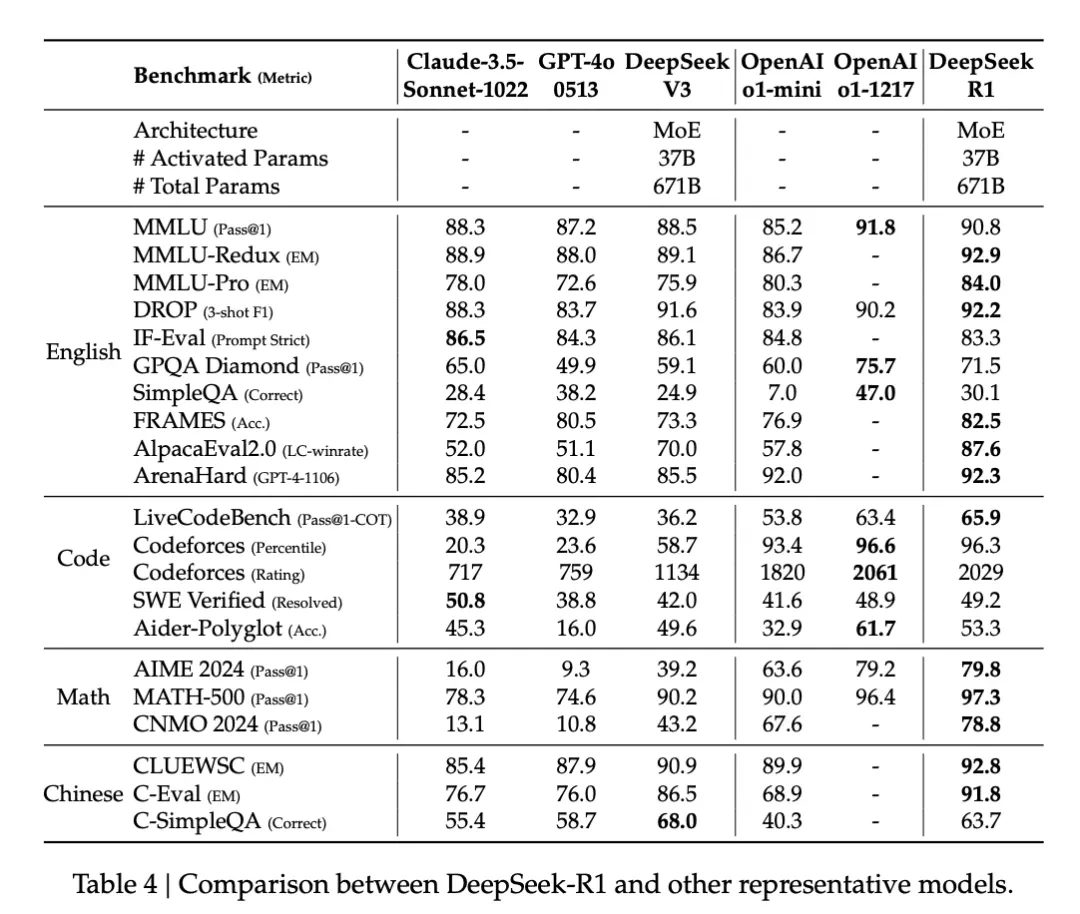

近期,大模型领域再掀波澜,国内公司月之暗面和DeepSeek分别发布了其最新的大模型:多模态思考模型K1.5和DeepSeek-R1,性能直逼OpenAI的o1模型。DeepSeek-R1尤其引人注目,其在数学、代码和自然语言推理等任务上的表现令人震惊。

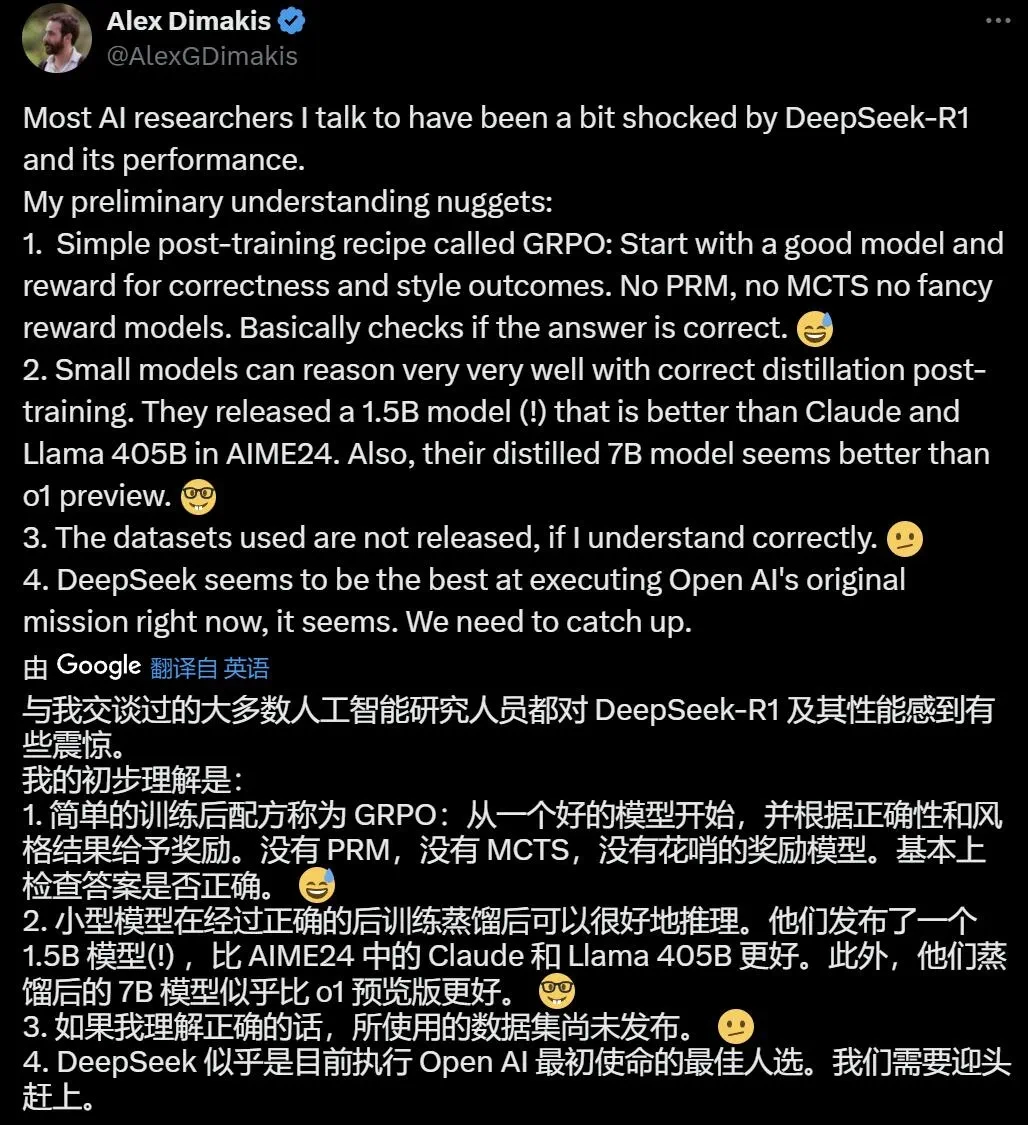

DeepSeek-R1采用多阶段循环训练方式:基础模型训练→强化学习(RL)→微调→RL→微调→RL,最终打造出660B参数的强大模型。UC Berkeley教授Alex Dimakis甚至认为DeepSeek已处于领先地位,美国公司需奋起直追。

DeepSeek-R1已在网页端、App端和API端全面上线,用户可直接体验其强大功能。

体验地址:https://www.php.cn/link/6226c5b0f6a9b68f3dee542ab5c34545

DeepSeek同时发布了两个660B参数的模型:DeepSeek-R1-Zero和DeepSeek-R1,并开源了模型权重,允许用户基于R1进行二次开发。

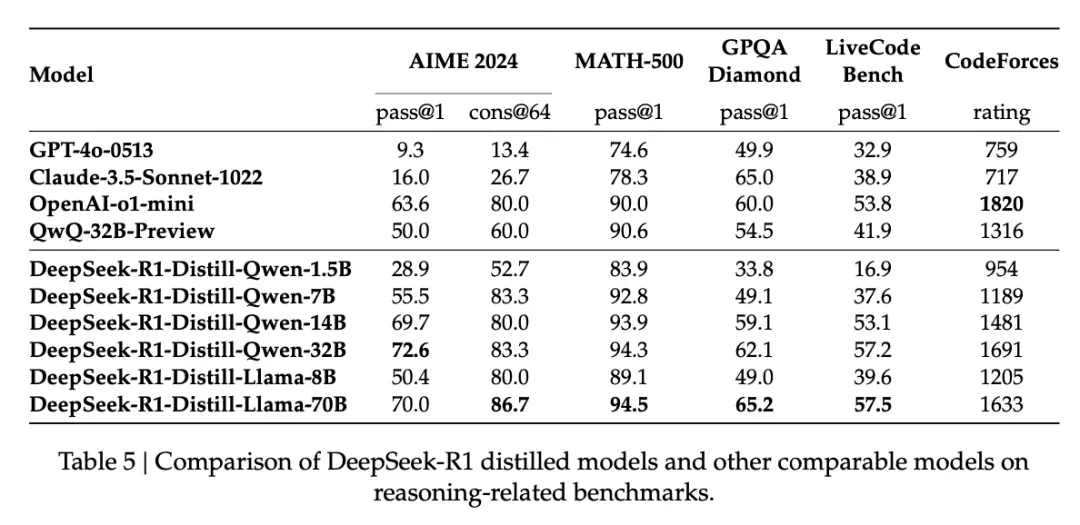

DeepSeek-R1还蒸馏出了六个更小参数的模型(1.5B、7B、8B、14B、32B和70B),同样完全开源。

模型下载地址:https://www.php.cn/link/f9d81ff01aec9a8625983fe8f5c382f0

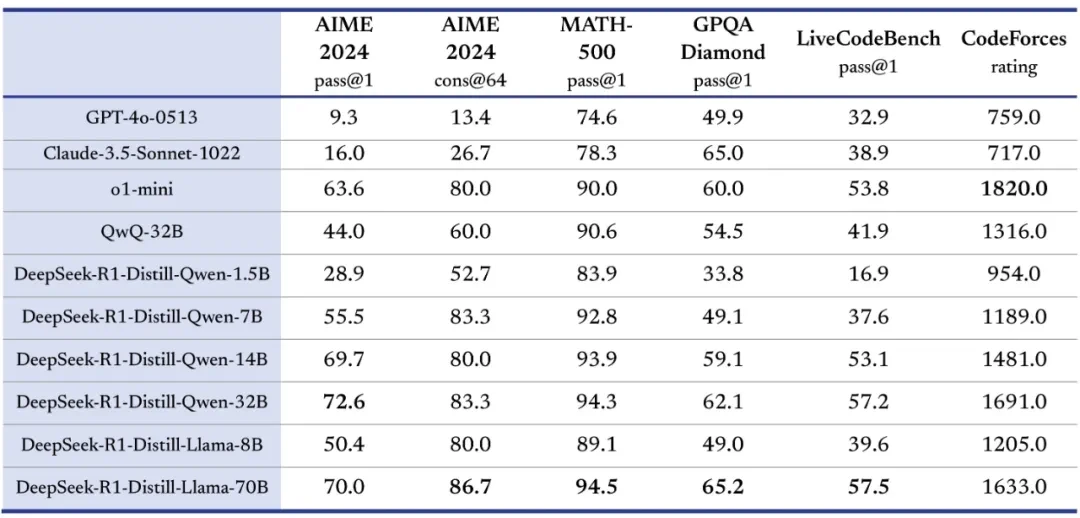

其中,32B和70B版本的性能远超GPT-4o、Claude 3.5 Sonnet和QwQ-32B,接近o1-mini。

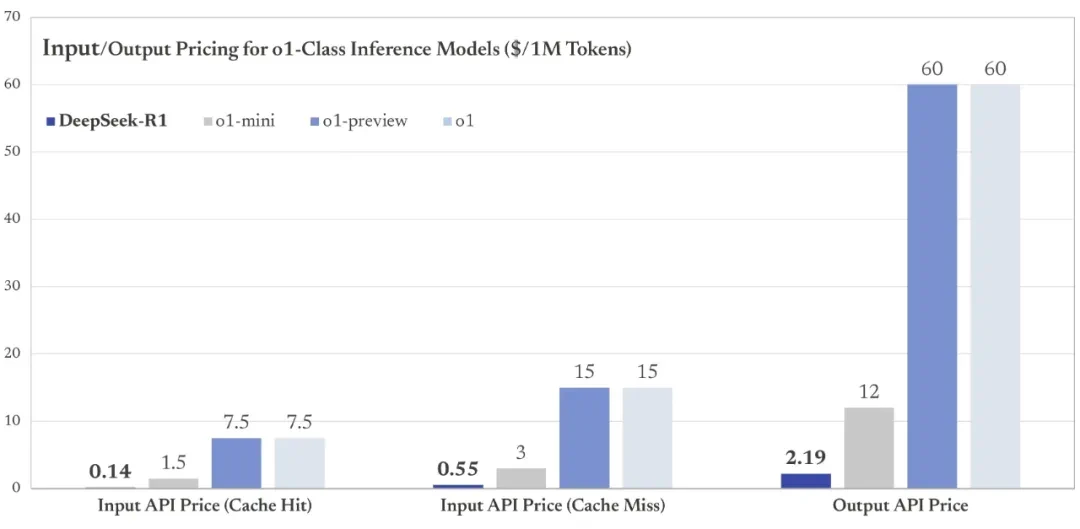

DeepSeek-R1 API价格也极具竞争力,远低于OpenAI o1 API。

DeepSeek秉持开源原则,公开了R1模型的训练技术和研究论文。

论文链接:https://www.php.cn/link/68e3029766c319b18533206bed2ef83f

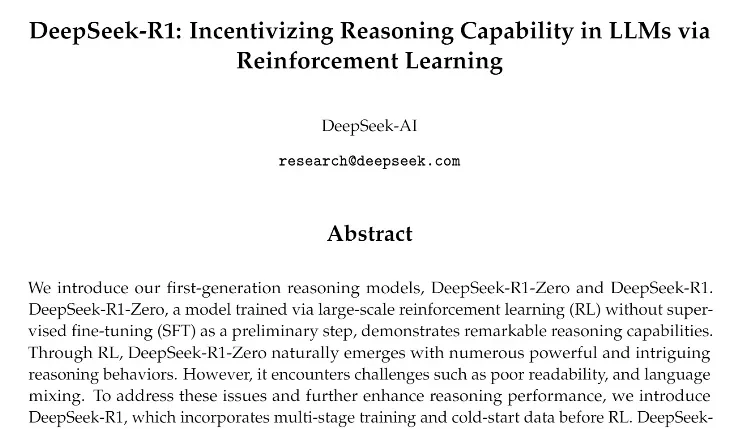

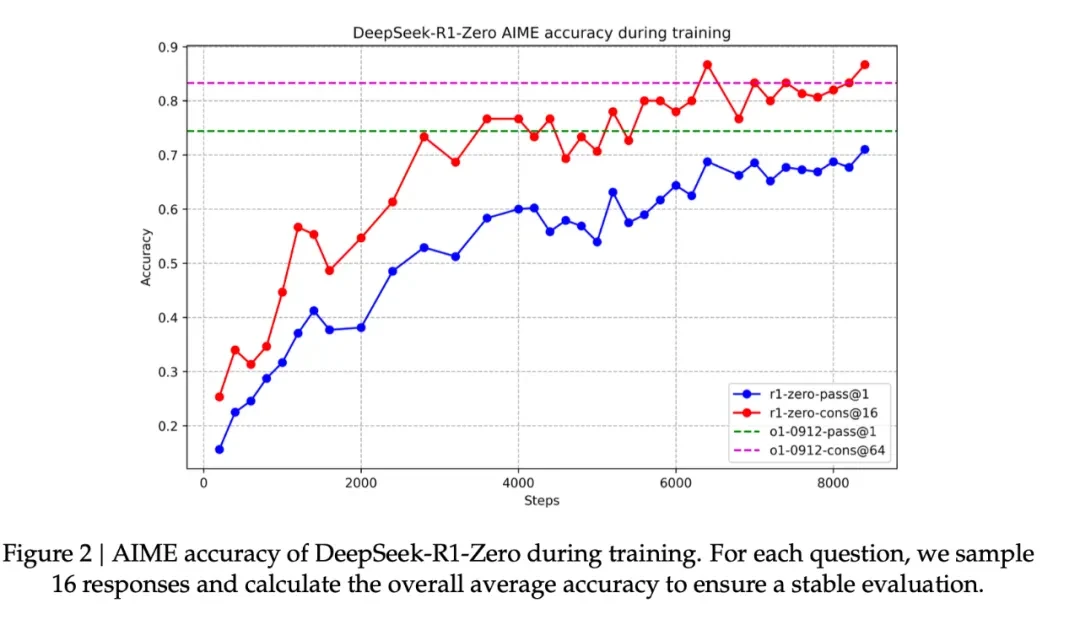

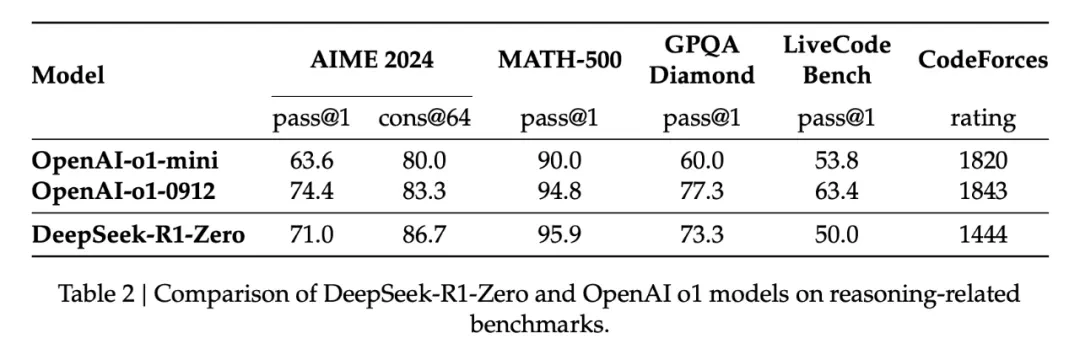

DeepSeek-R1的技术创新之处在于,它通过大规模强化学习,即使在少量标注数据的情况下,也能显著提升模型推理能力。其核心技术包括:群组相对策略优化(GRPO)、准确度和格式双重奖励机制以及最小干预的训练模板。DeepSeek-R1-Zero更是展现了显著的自我进化能力,能够自主发展出高级解题策略。

DeepSeek-R1还通过冷启动数据微调、多阶段强化学习和模型蒸馏等技术,进一步提升了模型性能和效率。 最终的模型在多个基准测试中取得了优异的成绩。

DeepSeek-R1的出现,标志着国产大模型在性能和性价比方面取得了重大突破,值得期待其未来发展。